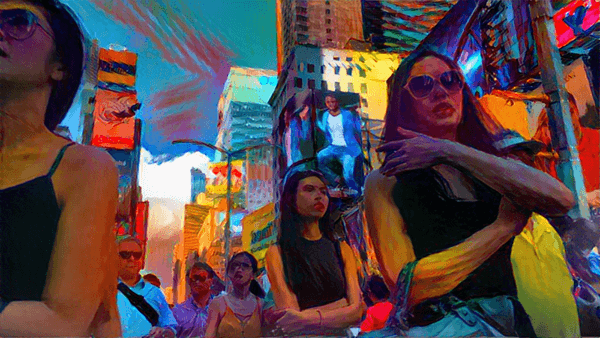

Mine de rien, les algorithmes sont devenus une partie intégrante de nos vies, ils peuvent nous aider à trouver l’âme sœur sur des sites de rencontres, peuvent piloter des robots musiciens, ou tout bêtement vous suggérer l’article que vous lisez en ce moment. S’ils peuvent faire tout ça, pourquoi ne se mettraient-ils pas à peindre ? C’est l’idée qu’a eue Danil Krivoruchko avec le projet Deep Slow Flow, et son premier extrait NY Flow qui nous en met déjà pleins les yeux

BEWARE : Tu peux me dire comment tu en es arrivé à ce projet ?

DANIL : Il y a quelques mois, je suis tombé sur une vidéo tech de mecs qui présentaient une démo à l’Université de Freiburg. Ils montraient comment ils avaient introduit un algorithme sous forme de réseau de neurones. Je me suis dit que ça pouvait clairement servir de base pour un projet expérimental. Un mois plus tard, j’ai remarqué qu’ils avaient mis leur code source en accès libre, mais bizarrement personne ne s’en servait. Du coup, je l’ai pris pour moi.

B : J’imagine que c’est énormément de travail derrière

D : Ça n’a pas été facile à mettre en place en fait. Leur code source devait être utilisé sur Ubuntu, et pour qu’il tourne bien, je devais rajouter d’autres librairies qui elles mêmes demandaient d’autres ressources qui elles mêmes… Tu as compris l’idée. C’était peut être une routine pour quelqu’un avec ces notions, mais pas pour quelqu’un comme moi qui vient du motion design et des effets spéciaux. Après avoir googlé tous mes problèmes techniques pour m’en sortir, j’ai finalement réussi à faire ce que je voulais et j’ai été super impressionné du résultat.

B : Tu peux me parler du processus de la première vidéo à New York, ça a été filmé comment?

D : J’ai demandé à une amie photographe talentueuse, Tatiana Stolpovskaya, de filmer dans les rues de New York, là où on habite. Comme on savait que tout l’effet de la vidéo passerait en post production, on a évité de dépenser le prix d’une steadicam et on a simplement tourné ça à l’iPhone 6. Viktoriya Yakubova, qui est réalisatrice de documentaires, s’est occupée du montage et j’avais tout ce qu’il fallait pour travailler dessus, et rajouter cet effet en slow motion pour appuyer le côté irréel de la vidéo après traitement.

B : Qu’est-ce qui a pris le plus de temps dans le processus?

D: Après avoir choisi le style qui rendait le mieux pour chaque image, on a fait un rendu, c’est ce qui a été le plus chronophage. Il faut comprendre que le réseau de neurones bouffe beaucoup en hardware, même pour de la demi haute définition avec une bonne configuration matérielle il faut compter 2/3 minutes de calcul par images. Avec la mienne, ça a pris plusieurs heures par image. Deux semaines plus tard, tout était prêt. J’ai rajouté quelques effets en post production pour corriger les détails moches, les glitches, rajouter du flou.

B : Est-ce que c’est moi, ou cette esthétique est en train de devenir une mode? Par exemple, tu as entendu parler de l’application Prisma qui donne le même résultat mais pour les photos?

D : Oui bien sûr, et en fait j’ai des amis en commun avec les développeurs de Prisma, avec lesquels j’ai même envisagé de travailler sur un autre projet. C’est drôle que tu en parles, même si Prisma n’a rien à voir avec un système de réseau de neurones. Après concernant l’esthétique, c’est juste 5 minutes de gloire pour moi, la hype va retomber et je ferai autre chose, ça ne veut pas dire que ce style va disparaître complètement, ça deviendra peut être une niche comme le glitch ou le pixel art.

B : Je pense aussi au film qui va sortir sur Van Gogh, où toutes les images ont été peintes à la main. Tu n’as pas l’impression d’avoir tué leur processus avec ton algorithme ?

D : ahah, techniquement, ce n’est pas moi qui ai “tué” leur processus, j’ai juste utilisé un outil que des mecs bien plus intelligents que moi ont développé

B : C’est le genre de discussion qui peut finir par dériver sur “l’homme vs. La machine, c’est bien ou pas bien?”

D : Je ne vois pas le problème avec ce genre de technologie émergente. La peinture n’a pas tué la photo, et le théâtre se porte bien malgré l’existence du cinéma et de la télé. En fait, c’est même bénéfique pour l’art et les médias traditionnels de sortir du statu quo et de les faire évoluer. Je pense que le réseau de neurones artificiels deviendra au final un outil pour les gens créatifs. Regarde, ce n’est pas parce que tu as un iPhone que cela fait de toi un bon photographe.

B : C’est quoi la suite du projet Deep Slow Flow?

D : Honnêtement, je ne sais pas comment évoluera ce projet. Pour l’instant, je veux juste donner à mes amis l’occasion de faire quelque chose de nouveau en vidéo, et pour moi c’est une excuse pour jouer avec la technologie ahah. Mais si ce projet grandit, je n’en serai que plus heureux. D’ailleurs,on recherche des vidéastes qui souhaiteraient rejoindre le projet en soumettant 15-20 secondes de film en slow motion. L’idée est qu’au final on ait des petits films de ce genre venant de partout dans le monde.

NY FLOW – Crédits:

Camera: Tatiana Stolpovskaya

Editing: Viktoriya Yakubova

Music: Candles by Jon Hopkins

Direction & VFX: Danil Krivoruchko

Open source code by Manuel Ruder, Alexey Dosovitskiy and Thomas Brox

Si vous êtes vidéaste et que vous voulez participer à ce projet, envoyez vos films ici

Suivez le projet Deep Slow Flow sur Instagram / Behance

Eric Rktn est sur Twitter